大模型赛道又迎来一家新企业。

作者|赵健

3月23日,一家颇为低调的通用大模型创业公司——阶跃星辰在2024全球开发者先锋大会上正式亮相。

阶跃星辰成立于2023年4月,是微软系创业的大模型公司,目前有150人左右。阶跃星辰创始人、CEO姜大昕,是前微软全球副总裁、微软亚洲互联网工程院首席科学家,也是阶跃星辰的算法负责人。

阶跃星辰的核心创始团队包括系统负责人朱亦博和数据负责人焦斌星。朱亦博此前先后在微软、字节跳动等公司从事算力集群相关工作,拥有多次单集群万卡以上的系统建设与管理实践经验;焦斌星此前担任微软必应引擎核心搜索团队负责人,负责利用数据挖掘和NLP算法优化索引和搜索质量。

随核心创始团队一同亮相的还有阶跃星辰的Step系列通用大模型,包括Step-1千亿参数语言大模型、Step-1V千亿参数多模态大模型以及Step-2万亿参数MoE语言大模型预览版。

同时,阶跃星辰还发布了两款面向C端的产品「跃问」与「冒泡鸭」。跃问是AI聊天类应用,定位个人效率助手;冒泡鸭是由剧情和角色组成的AI开放世界,满足娱乐和社交需求。

阶跃星辰以“智能阶跃,十倍每一个人的可能”为使命,以实现AGI为目标,并提出了两点核心认知:一是坚信Scaling Law,在算力、算法、数据与系统四要素综合布局;二是把多模态理解与生成的统一作为走向AGI的必经之路。

近期,「甲子光年」等与阶跃星辰核心创始团队进行了一场深度交流,详细揭开这家大模型公司的神秘面纱。

1.“ChatGPT让我懵了很长一段时间”

为什么要离开微软迈上大模型的创业旅程?

作为一名“微软老兵”,姜大昕在微软做了16个年头,他大学毕业之后不久就加入了微软亚洲研究院。

姜大昕把他的微软生涯分成了两个阶段。第一阶段是做研究。但姜大昕是一个不太安分的研究员,总想着如何把自己的研究工作与产品结合起来。2008年,姜大昕和团队获得了SIGKDD(国际数据挖掘与知识发现大会)的最佳论文奖,这个奖项看重的是研究工作在实际产品中创造的价值和影响力。

第二阶段始于2011年,姜大昕从研究院换到产品组,负责必应搜索引擎的研发,负责产品的同时兼任互联网工程院的首席科学家。搜索引擎既有非常多的算法,又是一个庞大的工程化工作。在此期间,姜大昕团队发表了很多论文,获得了数万次的引用,同时把每一代的技术(CNN、LSTM、BERT等)都用在了搜索产品中。

2022年,ChatGPT出现了。姜大昕问ChaGPT的第一个问题是:“你多大了?”在过去,这个对人类而言再简单不过的问题,会难倒所有的机器,因为基于检索的机器无法建立“常识”与“推理”。但ChatGPT的回答是,它在2019年被训练完成,今年是2022年,所以是3岁。

姜大昕又问:“你明年多大?”这个问题的难点在于要理解明年是“今年+1”,然后再把数字代进去算一遍,这个过程就是推理。ChatGPT又回答出来了。

ChatGPT的回答让姜大昕非常非常震撼,“有种鸡皮疙瘩出来的感觉”,让姜大昕懵了很长一段时间。

姜大昕意识到ChatGPT是一个划时代的技术变革。他形容当时每天的心情都是“世界从身边呼啸而过,留下自己在风中凌乱”。姜大昕希望了解更多ChatGPT背后的技术细节,但是OpenAI的模型是一个黑盒,只能调用API。

姜大昕有点不甘心,他希望能解开模型背后的秘密,甚至对模型算法做出更好的改善。既然在微软无法实现,那就只有躬身入局。于是,创业的念头产生了。

姜大昕准备找一些志同道合的人聊聊。结果还没出门找别人,焦斌星博士就先一步找上门了。

姜大昕跟焦斌星在屋子里聊了两个多小时,两人的想法完全一致,不甘心在别人的模型上做应用,而是想亲自下场做模型。

于是,两位微软同事一拍即合。但是做大模型只有算法和数据还不够,算力与系统能力也至关重要。姜大昕找来了此前拥有多次单集群万卡以上的系统建设与管理实践经验的朱亦博,三人成行。

2023年4月,阶跃星辰正式成立。

2.坚定攀登Scaling Law

阶跃星辰的名字来自阶跃函数(step function)。姜大昕认为,通用人工智能会让每个人、每个领域迎来从0到1的跃变时刻,因此也需要用更坚定的信念去一步一步(step by step)地实现它。

阶跃星辰的目标跟OpenAI一样,都瞄向了最终的AGI。姜大昕与团队对AGI进行了深入思考,并总结了关于AGI的两个认知。

首先,阶跃星辰坚信OpenAI提出的Scaling Law。

姜大昕认为,过去几年不同的大模型一再验证了Scaling Law的可行性。模型的参数量相当于人脑的神经元数量,它决定了模型能力的上限。人脑神经元之间的连接大约有200万亿次,目前大模型还远未达到这一量级。

但是提升模型参数并非易事。比如,从头训练一个GPT-3.5量级的千亿模型已经是一个不低的门槛,但从千亿扩大到万亿,模型只增长10倍,难度却增长几十倍,这其中需要“算法、系统、算力、数据”四要素的综合布局,非常考验一家创业公司的能力,也决定了这家公司能走多远。

在算力层面,GPT-4训练大约用了2.5万张A100。如果要训练一个万亿参数模型,大约需要数万张等效于A800的高性能芯片。

阶跃星辰成立的第一天起就意识到算力是非常重要的战略资源。一方面通过自建机房,另一方面采用了云上算力,目前具备训练万亿参数模型的算力。其次,仅是算力堆积还不够。因为裸机放在一起是没办法训练模型的,需要搭建一个“系统”,在上面构建一个高效能的训练平台。搭建系统的难点在于要把数万张卡放在单一集群中。如果是不同的集群,集群与集群之间需要通讯,而这个通讯速度非常慢,无法支撑模型训练的高效能计算。

单一集群的难点在于保证集群的高效与稳定,一方面,让芯片的计算、内存、网络通讯像流水线一样时刻保持运行,提高资源的利用率。另一方面,要保证在万卡中出现单卡的故障时,不影响整个系统的训练。

对算力系统进行极致优化,需要具有前瞻性的认知和丰富的经验,阶跃星辰的系统负责人朱亦博正是这方面的专家。阶跃星辰训练千亿模型的MFU(有效算力输出)为57%。作为对比,LLama 2 70B模型的训练MFU大约为45%。

此前,“系统”在大模型的重要性往往被低估了。比如,前谷歌大脑高级研究科学家Yi Tay辞职创业做大模型,在今年3月6发表博客《Training great LLMs entirely from ground up in the wilderness as a startup》感慨从头搭建系统有多难。在大厂时有大厂稳定的系统集群作为保障,而出来创业搭建系统的坑每一个都要亲自走一遍。

姜大昕从前到后仔仔细细读了这篇博客,却没法与作者共情。“后来我转念一想,是因为我们有一个强大的系统团队,如果不是亦博的话,我们可能掉过很多次坑了”。姜大昕说道。

第三个要素是数据,数据质量决定模型质量。

在训练大模型时,阶跃星辰遇到的最大的挑战是中文高质量数据的匮乏。比如常用的数据集CommonCrawl中仅有0.5%中文可用有效数据。

怎么办呢?阶跃星辰发现,其实大模型对语言不敏感,一个知识点不管用中文还是英文,都能学会,语言对于大模型只是一种编码方式而已。因此,阶跃星辰拿互联网上的全球语料来弥补中文语料的缺失,而在微软做过搜索引擎的数据团队,对此有非常深入的了解与实践。在非公开的行业数据层面,阶跃星辰与国内优秀的数据资源实现深度合作。最后一个要素是算法。阶跃星辰对于算法的摸索尝试可以总结为一句话——多模态的理解与生成的统一。这也是阶跃星辰对实现AGI的第二个认知总结。

3.理解了OpenAI,也就理解了阶跃星辰

在介绍阶跃星辰的算法路线之前,先看一下业内标杆OpenAI的路线。

OpenAI号称要实现AGI,而它的产品动作令人眼花缭乱。除了语言模型GPT系列之外,OpenAI还发布了文生图模型DALL-E、文生视频模型Sora,投资了具身智能公司Figure,在“宫斗”期间放出Qstar计划,OpenAI CEO萨姆·奥尔特曼还去中东准备融资7万亿美元实现他的芯片计划。

OpenAI背后的统一逻辑是什么?姜大昕认为,OpenAI看似杂乱无章的动作背后,其实一直是在沿着一条主线、两条支线在推进其AGI计划。

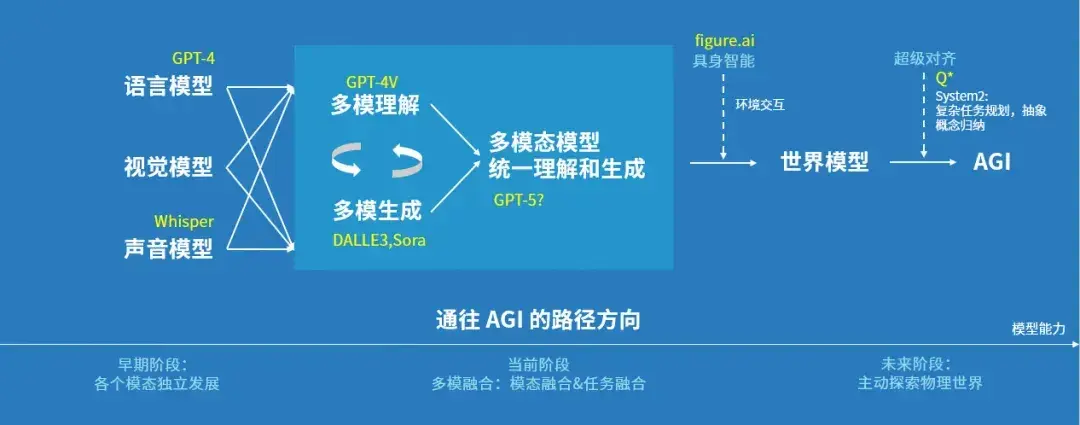

姜大昕表示,大模型的演进将会经历三个阶段。早期阶段是语言、视觉、声音各个模态独立发展,当前阶段是多模融合阶段,比如GPT-4V可以理解输入的文字与图像,Sora可以根据输入的文字、图像与视频生成视频。

但现阶段的多模态融合还不彻底,“理解”与“生成”两个任务是分开进行的,造成的结果是GPT-4V理解能力强但生成能力弱,Sora生成能力强但理解能力有时候很差。姜大昕认为,多模态理解与生成的统一是走向AGI的必经之路,这是一个非常关键的认知。

基于此认知,姜大昕也猜测Sora不是最终目标,只是一个中间状态。OpenAI下一个发布的模型,很有可能是多模态理解与生成的统一模型。

当理解与生成统一之后,就可以与具身智能结合起来,让模型与物理世界进行交互,自己收集环境数据,从而进一步建立世界模型;在世界模型的基础上,再加上复杂任务的规划、抽象概念归纳的能力,Qstar的强化学习算法能力,以及超级对齐能力,就有可能实现AGI。

姜大昕对于OpenAI的AGI路径看的很清楚,但并非跟着OpenAI的节奏亦步亦趋。阶跃星辰从成立之初也想清楚了这条主线,公司展厅的展板上就画出了从单模态模型到世界模型的不同发展阶段。

基于上述认知与工作准备,阶跃星辰公布了三款大模型以及两款产品。

Step-1是一个单模态的千亿语言模型,性能全面超越GPT-3.5;Step-1V是千亿参数多模态大模型,对标GPT-4V;Step-2是万亿参数的MoE语言大模型(预览版),综合体感对标GPT-4。

在落地方向上,阶跃星辰没有选择做落地更快但有更多定制化的to B,而是把重心放在了市场空间更大,但仍需要找到PMF的to C。

目前,阶跃星辰围绕Step-1和Step-1V千亿参数大模型的产品和生态已经打磨成熟,推出了两款面向C端用户的大模型产品——跃问和冒泡鸭。跃问是AI聊天类应用,定位个人效率助手;冒泡鸭是由剧情和角色组成的AI开放世界,满足娱乐和社交需求。

此外,阶跃星辰在金融、网络文学、知识服务等领域已与合作伙伴达成深度合作,共同探索面向C端用户的创新应用。在金融领域,阶跃星辰与上海报业旗下界面财联社达成深度合作,双方围绕 AIGC 财经资讯、智能投研、智能投顾等领域推进大模型的应用落地。在网络文学领域,阶跃星辰与中文在线独家达成深度战略合作,共同探索大模型在灵感激发、内容创作等网络文学创作领域的应用。在知识服务领域,阶跃星辰与中国知网、中文在线达成战略合作,围绕大众知识服务等场景研究和推进大模型的应用。

姜大昕表示阶跃星辰的使命是:“智能阶跃,十倍每一个人的可能。”

(封面图及文中配图来源:阶跃星辰)

6908

6908 0

0 0

0 0

0